Open source w security – dlaczego kusi startupy

Czym naprawdę jest open source, a czym tylko „darmowe” oprogramowanie

Open source w kontekście startupów security to nie tylko „kod za darmo do pobrania z GitHuba”. Kluczową cechą jest licencja, która pozwala na:

- wgląd w kod źródłowy,

- modyfikowanie go i tworzenie własnych wersji,

- dystrybucję zmodyfikowanego lub niezmodyfikowanego kodu,

- często także użycie komercyjne – ale już na określonych warunkach.

„Darmowe oprogramowanie” bywa mylące. Może oznaczać freeware (np. darmowe narzędzie AV dla użytkownika domowego), w którym:

- kod źródłowy jest zamknięty,

- modyfikacje są zabronione,

- komercyjne wykorzystanie bywa ograniczone zapisami licencyjnymi.

Startup security zwykle potrzebuje kontroli technicznej nad komponentem: możliwości poprawienia błędu, dostosowania mechanizmu logowania czy integracji z własnym systemem reguł. Tu freeware nie wystarczy – potrzebny jest prawdziwy open source, z jasną licencją (MIT, Apache, GPL itd.).

Dlaczego startupy security tak chętnie sięgają po open source

Branża cyberbezpieczeństwa rozwija się gwałtownie, a zagrożenia zmieniają się szybciej niż slajdy w decku inwestorskim. Open source jest kuszący z kilku powodów:

1. Tempo budowy produktu

Budowanie od zera własnego systemu logowania, parsowania protokołów, kryptografii czy orkiestracji kontenerów to luksus, na który mało który startup może sobie pozwolić. Gotowe biblioteki open source pozwalają:

- postawić MVP w tygodnie, nie w miesiące,

- skupić zespół na logice bezpieczeństwa (reguły, korelacje, UX dla analityka),

- szybko weryfikować hipotezy produktowe.

2. Ograniczony budżet

Licencje komercyjne na zaawansowane komponenty security potrafią kosztować tyle, co roczny budżet pre-seedowego startupu. Open source obniża próg wejścia: zamiast płacić za każdy element układanki, zespół inwestuje przede wszystkim czas i kompetencje. Oczywiście „za darmo” zamienia się później na koszt:

- utrzymania zależności,

- patchowania podatności,

- zgodności licencyjnej.

To rachunek, który prędzej czy później i tak przychodzi – ale można go rozłożyć w czasie.

3. Rekrutacja i wizerunek technologiczny

Dobry inżynier security niemal na pewno ma styczność z open source: korzysta z narzędzi, kontrybuuje łatki, utrzymuje własne skrypty. Startup budujący produkt na sprawdzonym stacku open source:

- jest bardziej atrakcyjny dla kandydatów („będę pracować z narzędziami, które znam”),

- może pokazać swój kod publicznie i w ten sposób budować markę techniczną,

- zyskuje od razu punkt odniesienia – senior wie, co jest w środku, zanim podpisze umowę.

Open source a zaufanie do rozwiązań bezpieczeństwa

W cyberbezpieczeństwie zaufanie ma wymiar praktyczny: klient chce wiedzieć, co dzieje się z jego danymi, w jaki sposób działają algorytmy detekcji, czy nie ma ukrytych „magicznych” funkcji. Open source ułatwia następujące rzeczy:

- Audytowalność – kod można poddać niezależnemu przeglądowi, włącznie z formalnym audytem zewnętrznym.

- Przejrzystość algorytmów – szczególnie ważna przy detekcji anomalii, korelacjach zdarzeń i automatyzacji reakcji.

- Brak vendor lock-in w warstwie krytycznej – klient ma poczucie, że nie jest skazany na jednego dostawcę, jeśli serce systemu jest oparte na popularnym projekcie open source.

W praktyce nabywcy B2B pytają: „na czym to jest zbudowane?” i reagują dużo spokojniej, gdy słyszą nazwy znanych projektów open source, niż gdy słyszą: „autorski, zamknięty silnik, nikomu nie pokazujemy kodu”. Zwłaszcza wtedy, gdy rozwiązanie ma mieć dostęp do logów, ruchu sieciowego, danych użytkowników.

Open source jako katalizator innowacji w bezpieczeństwie

Security to ciągłe ściganie się z atakującymi. Open source pozwala przyspieszyć ten wyścig:

- łatwiej eksperymentować z nowymi algorytmami (np. open source’owe biblioteki ML do klasyfikacji zdarzeń),

- można forknąć projekt, który nie nadąża za potrzebami (np. dodać własne parsowanie rzadkiego protokołu),

- społeczność reaguje szybko na nowe zagrożenia – łatki trafiają do głównego repozytorium w ciągu godzin lub dni.

Wiele przełomowych narzędzi security zaczynało od prostego projektu open source: skaner, parser logów, lekki agent. Dookoła nich budowane były później rozbudowane platformy z dodatkowymi, komercyjnymi modułami, usługą SaaS, wsparciem enterprise czy integracjami.

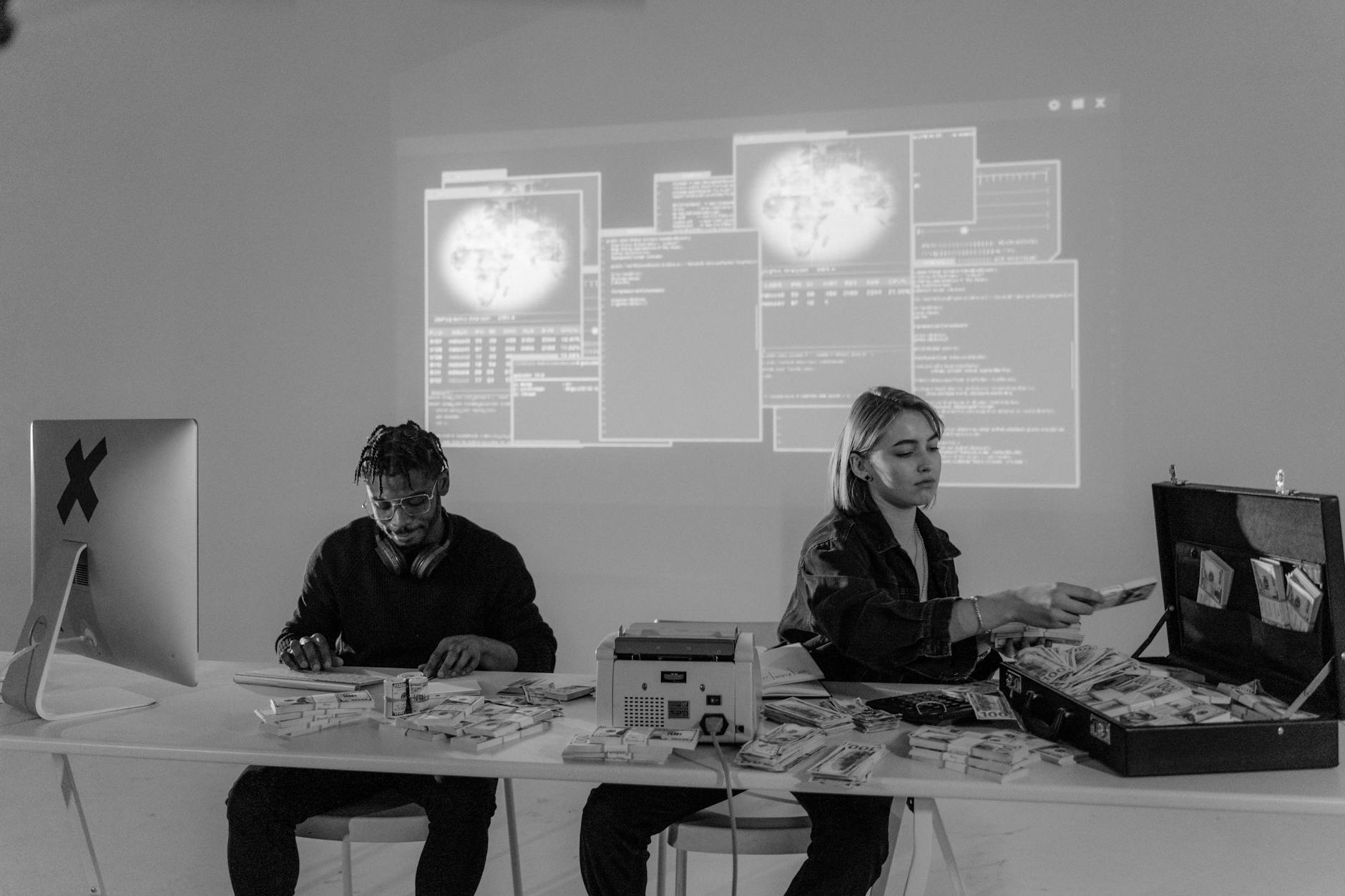

„MVP z 27 bibliotek” – typowy start i jego ukryte koszty

Kto nie zbudował pierwszego MVP z „wszystkiego, co było na GitHubie”, niech pierwszy rzuci commit. Klasyczna historia:

Mały zespół tworzy w tydzień działający prototyp skanera logów. W środku ląduje:

- framework webowy,

- silnik wyszukiwania,

- kilka parserów formatów logów,

- moduł do metryk,

- kilkanaście mniejszych bibliotek „do wszystkiego”.

Działa. Demo wypadło świetnie. Problem zaczyna się, gdy pierwszy klient pyta o:

- listę użytych komponentów (SBOM),

- licencje i zgodność z polityką firmy,

- proces zarządzania podatnościami w tych bibliotekach.

Wtedy okazuje się, że nikt do końca nie wie, co dokładnie siedzi w vendor/ albo node_modules, jakie są licencje i kiedy ostatnio były robione aktualizacje. To typowa mina, na którą warto się przygotować od pierwszych commitów – zwłaszcza w startupie security, gdzie klienci są od początku podejrzliwi z definicji.

Anatomia typowego stacku open source w startupie security

Warstwy: od systemu po DevSecOps

Typowy produkt security to nie jedna aplikacja, tylko stos kilku warstw, z których każda niesie swoje ryzyka i wymagania.

Warstwa systemowa

Tu zwykle ląduje:

- Linux (Ubuntu, Debian, CentOS, AlmaLinux itp.),

- czasem specjalizowane dystrybucje hardened,

- komponenty jądra, jeśli budujemy agenta EDR lub rozwiązania niskopoziomowe.

To fundament, który decyduje o możliwościach monitorowania, sandboxingu, izolacji oraz integracji z istniejącą infrastrukturą klienta.

Kontenery i orkiestracja

Zdecydowana większość nowych startupów security idzie w:

- Docker lub alternatywy kontenerowe,

- Kubernetes jako platformę orkiestracji,

- dodatkowe projekty typu Helm, Istio, Prometheus, Grafana.

Bazy danych i silniki wyszukiwania

Analiza logów, zdarzeń i telemetry to domena:

- relacyjnych baz typu PostgreSQL,

- silników wyszukiwania (Elasticsearch, OpenSearch, Meilisearch),

- czasem baz czasoszeregowych (TimescaleDB, InfluxDB).

Biblioteki kryptograficzne

W security nie wypada pisać własnych prymitywów kryptograficznych. W grę wchodzą:

- OpenSSL / LibreSSL,

- libsodium / NaCl,

- wbudowane biblioteki kryptograficzne języka (np.

cryptow Go, RustCrypto, BouncyCastle).

Frameworki i narzędzia security

Działka zależy od typu produktu:

- dla SIEM/EDR – frameworki do zbierania i korelacji logów, agenci systemowi,

- dla skanerów – biblioteki do analizy protokołów (HTTP, DNS, SMTP), narzędzia do fingerprintingu,

- dla DevSecOps – narzędzia do skanowania kodu SAST, DAST, SCA, oraz integracje CI/CD.

Przykładowy „minimalny” stack dla narzędzia do analizy logów

Wyobraźmy sobie mały startup budujący narzędzie do szybkiej analizy logów bezpieczeństwa z serwerów i aplikacji. „Minimalny” stack open source może wyglądać tak:

- Backend: Go lub Python + framework webowy (np. FastAPI, Gin),

- Baza danych/analityka: PostgreSQL + OpenSearch/Elasticsearch,

- Agent zbierający logi: mały demon w Go/Rust z wykorzystaniem bibliotek do tailowania plików i wysyłki przez HTTPS,

- Frontend: React/Vue + komponenty UI,

- Monitoring: Prometheus + Grafana,

- CI/CD: GitHub Actions lub GitLab CI, wpięty skaner zależności.

W teorii – prosty zestaw. W praktyce każdy z tych komponentów ma własne:

- cykle wydawnicze,

- podatności bezpieczeństwa,

- licencje,

- zależności w głąb (czyli zależności zależności).

Taki „minimalny” stack może generować dziesiątki, jeśli nie setki, wpisów w SBOM-ie, który trzeba będzie kiedyś wysłać dużemu klientowi. Im szybciej proces ogarniasz, tym mniej bólu później.

Co zwykle jest open source, a co częściej bywa zamknięte

W startupach security można zauważyć pewien schemat:

- Open source:

- infrastruktura (system, bazy, kontenery, monitoring),

- common libraries (logowanie, HTTP, integracje),

- podstawowe agenty systemowe,

- część narzędzi do zbierania i parsowania logów.

- Zamknięte / komercyjne:

- silniki analityczne z przewagą algorytmiczną,

- reguły detekcji, playbooki automatyzacji,

- elementy sandboxingu, systemy reputacyjne, feedy Threat Intel,

- dodatkowe moduły integrujące się z produktami vendorów, którzy nie życzą sobie otwarcia.

Częstą praktyką jest model open core: rdzeń systemu (np. kolektor logów, podstawowy widok analityczny) jest open source, a zaawansowane funkcje (korelacje, machine learning, integracje enterprise, compliance) są dostępne w wydaniu komercyjnym.

Uzależnienie od ekosystemu: Python, Go, Rust, Node

Wybór języka i ekosystemu bibliotecznego to nie tylko kwestia wydajności i przyzwyczajeń zespołu. Z punktu widzenia bezpieczeństwa open source ma znaczenie:

- Python – ogromny ekosystem, mnóstwo bibliotek security, ale też:

- duża powierzchnia ataków na pip (typosquatting, złośliwe paczki),

- częste zależności kaskadowe (pakiet ciągnie za sobą kolejne 10).

- Node.js – słynne

node_modulesz tysiącami plików:- bardzo wysoka fragmentacja,

- wiele małych paczek o ograniczonym zaufaniu,

- liczne incydenty z backdoorami w popularnych pakietach.

- Go – względnie prosty model zależności (Go modules):

- mniej „warsztatowego” chaosu niż w Node,

- ale nadal podatności i ryzyka typosquattingu w publicznych repo.

- Rust – rosnący ekosystem, spory nacisk na bezpieczeństwo:

- Cargo ułatwia zarządzanie zależnościami,

- ale nie zabezpiecza przed złymi decyzjami (słaba jakość paczki, brak maintainerów).

W security często liczy się deterministyczne budowanie, powtarzalność i możliwość odtworzenia dokładnie tego samego środowiska za rok. To wymusza m.in.:

- pinowanie wersji zależności,

- mirrorowanie repozytoriów,

- kontrolę nad tym, skąd ściągane są paczki (własne registry).

Myślenie o audytowalności i regulacjach już na etapie doboru stacku

Startup security szybko zderza się z regulacjami: RODO, ISO 27001, NIS2, branżowe standardy finansowe czy zdrowotne. To wpływa na dobór komponentów open source. W praktyce oznacza to pytania:

Pytania compliance przy wyborze komponentów

Przy doborze stacku w security pytanie brzmi już nie tylko „czy to działa?”, ale też „czy to przejdzie audyt u banku lub operatora energetycznego?”. Zespół, który wrzuca do produkcji randomowy projekt z GitHuba, szybko poznaje pojęcia:

- data residency – gdzie realnie trafiają logi, metadane, crash dumpy, telemetry z bibliotek i agentów,

- sovereign cloud – czy komponenty (np. operator do K8s) nie wymagają komunikacji z chmurą spoza jurysdykcji klienta,

- certyfikacje – czy używany system, baza lub biblioteka ma referencje w środowiskach regulowanych (FIPS, Common Criteria, referencje od dużych podmiotów).

Checklisty bezpieczeństwa dużych klientów szybko dopytują o:

- aktualność wersji (EOL/EOS każdego komponentu),

- politykę wsparcia (kto patchuje, jak szybko, w jakim procesie),

- możliwość izolacji komponentów o niższym poziomie zaufania.

Jeśli już na etapie wyboru technologii uwzględnisz takie kryteria, unikniesz potem desperackiej wymiany np. bazy danych na tydzień przed POC-em w banku.

Licencje open source bez prawniczego bełkotu

Trzy pytania, które rozbrajają 80% min licencyjnych

Analizując licencję biblioteki, dobrze jest odpowiedzieć na trzy proste pytania:

- Czy ta licencja „zaraża” mój kod?

Innymi słowy – czy korzystając z tej biblioteki, muszę otworzyć cały swój produkt (copyleft), czy wystarczy zachować informacje o licencji i ewentualnie otworzyć modyfikacje biblioteki. - Czy mogę sprzedawać produkt z tym komponentem?

Czy licencja nie ogranicza zastosowań komercyjnych, SaaS, white-label itp. - Jakie obowiązki informacyjne mam wobec użytkownika?

Czy muszę wyświetlać notki copyright, dostarczyć kod źródłowy na żądanie, dołączyć pliki licencyjne w instalatorze, repozytorium, docker image.

Do tego dochodzi jeszcze jedno, praktyczne pytanie: czy ta licencja jest „enterprise-friendly”? Jeśli duże firmy mają automatyczny zakaz np. na AGPL, to możesz od razu wiedzieć, że komponent z taką licencją będzie problematyczny w sprzedaży.

MIT, Apache, BSD – „miłe” licencje permisive

Najbezpieczniejszym wyborem dla produktu komercyjnego są zazwyczaj licencje typu:

- MIT,

- Apache 2.0,

- BSD (2‑ lub 3‑klauzulowa).

Wspólny mianownik: możesz używać kodu w produkcie zamkniętym, sprzedawać go i nie musisz otwierać swojego kodu źródłowego tylko dlatego, że korzystasz z tej biblioteki.

Różnice, które mają znaczenie:

- MIT / BSD – bardzo proste, głównie wymagają zachowania informacji o prawach autorskich.

- Apache 2.0 – dodaje m.in. regulacje związane z patentami (udzielenie licencji patentowej i jej wygasanie przy sporze sądowym). W praktyce duże korporacje lubią Apache 2.0, bo jest dobrze zrozumiana przez prawników.

Jeśli możesz wybierać między kilkoma bibliotekami o podobnej jakości, ta z licencją MIT/Apache/BSD zazwyczaj wygra u działu prawnego klienta.

GPL, LGPL, AGPL – gdzie zaczynają się schody

Licencje copyleft wymagają większej ostrożności. Hasłowo:

- GPL – jeśli tworzysz program będący dziełem pochodnym (np. linkujesz bibliotekę w sposób statyczny lub mocno ją modyfikujesz), możesz być zobowiązany do udostępnienia kodu źródłowego twojego programu na tej samej licencji przy jego dystrybucji.

- LGPL – łagodniejsza; pozwala łączyć bibliotekę z kodem zamkniętym (zwykle przez dynamiczne linkowanie), ale wymaga udostępnienia zmian w samej bibliotece.

- AGPL – kontrowersyjna w SaaS. Obejmuje również udostępnianie aplikacji przez sieć, więc może wymagać upublicznienia źródeł, nawet jeśli nic nie „instalujesz” u klienta.

Dla startupu security, który celuje w klientów enterprise, AGPL często oznacza automatyczne „nie” po stronie ich prawników. Zdarzało się, że zespół musiał w panice wymieniać kluczowy komponent, gdy duży klient zauważył AGPL w SBOM-ie.

Licencje „source available” i pułapka pseudo-open source

Coraz popularniejsze są licencje typu SSPL, BSL czy różne własne „Community License”. Kod jest dostępny, ale:

- nie możesz go używać do budowy konkurencyjnej usługi SaaS,

- istnieją ograniczenia co do skali, klientów, sposobu wdrożenia,

- czasem licencja zmienia się w trakcie rozwoju projektu.

Dla produktowego startupu security takie komponenty bywają użyteczne, ale trzeba dokładnie przeczytać warunki komercyjne. Zwłaszcza gdy planujesz model OEM, white-label albo integracje z innymi platformami, które też sprzedają swoje SaaS-y.

Praktyczne zasady higieny licencyjnej

Zamiast udawać prawnika, lepiej wdrożyć kilka prostych nawyków:

- zbieraj SBOM od początku (np. Syft, CycloneDX, skanery SCA) i trzymaj go w repo,

- oznacz w repo biblioteki z licencjami „ryzykownymi” (AGPL, SSPL, customowe),

- ustal wewnętrzną „dozwoloną listę” licencji – np. MIT/Apache/BSD/LGPL ok, GPL/AGPL/SSPL tylko po zgodzie CTO/legala,

- pilnuj, żeby frontend, backend, agent i narzędzia buildowe też były objęte tą polityką (webpack z AGPL wtyczką potrafi zepsuć dzień tak samo jak baza danych z AGPL).

Niewielki wysiłek na starcie oszczędza tygodnie przepychanek z prawnikami klienta, którzy przepuszczą twoje SBOM-y przez swoje skrypty.

Model biznesowy a open source w cyberbezpieczeństwie

Open core – dlaczego tak kusi w security

Model open core pasuje do security jak ulał. Daje możliwość:

- otwarcia tego, co zwiększa adopcję (agent, kolektor, podstawowy UI),

- zamknięcia tego, co jest przewagą (silnik korelacji, reguły, sandbox, ML).

Typowa konstrukcja wygląda tak:

- Core open source:

- agent do zbierania logów / telemetry,

- kolektor, podstawowy pipeline,

- API do integracji.

- Dodatki komercyjne:

- zaawansowane dashboardy,

- gotowe reguły detekcji i playbooki SOAR,

- korelacje między klientami, Threat Intel, feedy reputacyjne,

- funkcje compliance (raporty pod konkretne normy, audyty).

Taki układ pozwala społeczności i integratorom rozwijać ekosystem wokół „rdzenia”, a jednocześnie zachować sensowny model sprzedaży. Problem zaczyna się, gdy granica między core a modułami płatnymi jest rozmyta – wtedy łatwo zrazić zarówno community („pseudo-open source”), jak i klientów („nie wiadomo, co kupujemy”).

SaaS, on-prem i „air-gapped” – różne światy, różne wymagania

Startup security często sprzedaje równolegle:

- SaaS – dla mniejszych klientów,

- on-prem – dla średnich i większych,

- air-gapped – dla krytycznej infrastruktury, wojska, części finansówki.

Open source pomaga w każdym z tych modeli, ale inaczej:

- w SaaS ekonomia skali zachęca do użycia maksymalnej liczby komponentów open source, by uniknąć gigantycznych opłat licencyjnych,

- w on-prem kluczowe jest to, czy klient zaakceptuje dane licencje w swoim środowisku i czy masz prawo dostarczyć mu obrazy zawierające wszystkie komponenty,

- w air-gapped pojawia się dodatkowo wymóg pełnej reprodykowalności buildów i możliwość dostarczania offline aktualizacji, reguł i modeli.

Im bardziej w stronę air‑gapped, tym istotniejszy staje się dostęp do źródeł i możliwość samodzielnego patchowania przez klienta (czasem zapisane w umowie). To kolejny argument za tym, by znać dokładnie licencje i zależności – w takich środowiskach pytanie „czy możemy sami zbudować ten komponent?” nie jest teoretyczne.

Usługi premium zamiast sprzedawania binarek

Open source w security świetnie wspiera model, w którym zarabiasz na:

- wdrożeniach i konsultingu – tuning reguł, integracje z istniejącą infrastrukturą,

- zarządzanych usługach SOC – budujesz platformę wokół swoich i cudzych narzędzi open source,

- aktualizacjach treści – reguły detekcji, sygnatury, reguły YARA, feedy IOC,

- feature flagach enterprise – SSO, RBAC, multi-tenant, audyty dostępu, wymagane przez duże organizacje.

Sam kod źródłowy coraz rzadziej jest „tym, za co się płaci”. W security klienci płacą za czas reakcji, jakość detekcji, niezawodność i to, że „ktoś nie śpi po nocach” i pilnuje ich środowiska. Open source ułatwia budowę narzędzi, ale przewaga powstaje gdzie indziej.

Ryzyko „fork fatigue” i rozjazdu z upstreamem

Klasyczna droga w startupach security to: „forkniemy, dodamy swoje ficzery, a kiedyś wrócimy do upstreamu”. Często kończy się to na:

- permanentnym forku, którego nikt poza tobą nie utrzymuje,

- narastającym długu technicznym, bo upstream idzie w inną stronę,

- trudnościach z łaniem poprawek bezpieczeństwa z głównej gałęzi projektu.

W security to szczególnie niebezpieczne, bo patchowanie podatności „ręcznie” w rozdwojonym kodzie robi się koszmarem. Dlatego jeśli już decydujesz się na forka:

- zapisz wprost strategię – czy to krótki eksperyment, czy świadomy długoterminowy fork,

- planuj regularne mergowanie upstreamu z budżetem na konflikty,

- utrzymuj listę własnych łat, które ewentualnie da się przerzucić do upstreamu.

Inaczej zamiast oszczędności z open source dostajesz własny, domowy projekt, który trzeba utrzymywać „na pełen etat”.

Bezpieczeństwo łańcucha dostaw oprogramowania – open source jako największy sojusznik i ryzyko

Od „git clone” do incydentu – jak naprawdę wygląda łańcuch

Łańcuch dostaw w startupie security rzadko jest prosty. Zwykle wygląda to mniej więcej tak:

- Programista dodaje nową bibliotekę z publicznego rejestru (pip/npm/Cargo/Go modules).

- CI ściąga kod z wielu serwerów, często przez publiczne mirrory i cache.

- Build system pakuje aplikację do obrazów kontenerowych, dołączając system bazowy (np. Debian, Alpine) z własnym zestawem paczek.

- Obrazy trafiają do rejestru (Docker registry) i stamtąd do środowisk staging/produkcja.

- U klienta obrazy są skanowane przez ich własne narzędzia SCA/Container Security.

Na każdym etapie mogą zdarzyć się niespodzianki: złośliwa paczka, podmieniony obraz bazowy, błędna konfiguracja CI. W security ironią jest to, że produkt chroniący klientów sam bywa futerałem dla cudzych błędów.

Ataki na rejestry i typosquatting – stare sztuczki, nowe skutki

Znane od lat sztuczki jak typosquatting czy umieszczanie złośliwych paczek w rejestrach pip/npm zyskują w security nowy wymiar: atakujący ma szansę znaleźć się bezpośrednio w infrastrukturze narzędzia ochronnego.

Kilka prostych praktyk redukuje ten wektor:

- blokowanie instalacji paczek spoza wewnętrznego mirroru (np. Artifactory, Nexus, własny registry),

- wymuszenie pinowania wersji w manifestach (brak „latest”, „>=1.2”),

- review dla dodawania nowych zależności – kto i po co je wprowadza,

- automatyczne skanowanie paczek przed dopuszczeniem do mirrora.

To trochę jak z dostępem do serwerowni: niby każdy inżynier mógłby wejść, ale rozsądniej jest mieć progi, logi i klucze niż potem tłumaczyć się z incydentu.

SBOM nie jako dokument, tylko proces

SBOM (Software Bill of Materials) coraz częściej jest wymagany przez:

Automatyzacja, podpisy i polityka „no trust by default”

SBOM ma sens tylko wtedy, gdy jest efektem zautomatyzowanego procesu, a nie ręcznym plikiem wrzuconym na pendrive kilka godzin przed podpisaniem kontraktu. Przy produktach security klienci oczekują, że:

- SBOM jest aktualny dla każdej wersji agenta, backendu, sensorów i narzędzi pomocniczych,

- da się go powiązać z konkretnymi obrazami (tagi, digesty, SH-y commitów),

- jest objęty tym samym procesem podpisywania i publikacji, co binarki.

Dlatego w security sens ma dopiero pełniejszy łańcuch:

- build tworzy SBOM (np. Syft, Trivy, CycloneDX-CLI),

- SBOM jest podpisany kryptograficznie (Sigstore/cosign, GPG),

- obraz kontenera / paczka binarna jest również podpisana i powiązana z tym SBOM-em,

- deploy w środowisku (także u klienta) wymusza weryfikację podpisów.

Bez tego lądujesz w klasycznym „security theater”: ładne pliki JSON/XML, z których nikt nic nie wynika. A kiedy w logach klienta pojawia się pytanie: „czy używacie podatnej wersji XYZ?”, jedyna uczciwa odpowiedź brzmi „nie wiemy, proszę dać nam tydzień”.

Reprodykowalność, hermetyzacja i buildy deterministyczne

W przypadku produktów security samo „działa u mnie” to za mało. Klienci, szczególnie ci z air-gapped i regulowanymi środowiskami, oczekują, że:

- jesteś w stanie odtworzyć build z konkretnego commita,

- build nie zależy od losowych zewnętrznych źródeł w czasie kompilacji,

- istnieje procedura audytu procesu budowania.

To prowadzi do kilku praktycznych wzorców:

- lokalne mirrory wszystkich używanych rejestrów (systemowych, językowych, kontenerowych),

- blokada bezpośrednich połączeń CI/CD do internetu (proxy, allowlisty),

- buildy deterministyczne tam, gdzie to możliwe (powtarzalny output przy tych samych źródłach),

- infra as code, która opisuje nie tylko aplikację, ale też sam pipeline.

To brzmi jak nadmiar formalizmu, dopóki ktoś nie zakwestionuje twojego produktu właśnie na etapie audytu łańcucha dostaw. Wtedy każda linijka kodu Terraform/Ansible opisująca CI staje się argumentem sprzedażowym.

Dependency management jako funkcja produktu, nie tylko inżynierii

Zarządzanie zależnościami rzadko trafia do roadmapy produktu. W startupach security to błąd, bo bezpośrednio wpływa na:

- czas reakcji na nowe CVE (SLA vs. rzeczywistość),

- wiarygodność komunikacji z klientami („tak, wiemy, używamy, łatka jutro”),

- zdolność do utrzymania wersji LTS dla wymagających klientów.

Praktyczny kompromis wygląda często tak:

- dla core’owych komponentów (agent, silnik detekcji) utrzymujesz zamrożone drzewo zależności z rzadkimi, kontrolowanymi aktualizacjami,

- elementy peryferyjne (UI, panele dla analityków) mogą mieć szybszy cykl aktualizacji,

- przygotowujesz plan awaryjny na sytuację, gdy kluczowa biblioteka przestaje być utrzymywana.

Ta ostatnia część bywa bolesna. Czasem rozsądniejsze jest przekodowanie fragmentu funkcjonalności niż wieczne życie z biblioteką-widmem, której maintainerem został przypadkowo twój zespół.

Współpraca z upstreamem jako element strategii bezpieczeństwa

Startup security często ma wrażenie, że „nie ma czasu na community”. Tyle że brak relacji z maintainerami krytycznych projektów open source szybko mści się przy incydentach bezpieczeństwa. Dobrze poukładana współpraca z upstreamem daje kilka bardzo konkretnych benefitów:

- szybszy dostęp do pre-release’ów łat bezpieczeństwa albo chociaż heads-up na Slacku/Discordzie,

- większy wpływ na priorytety – gdy podatność dotyka twoich klientów, możesz pomóc ją naprawić zamiast tylko czekać,

- możliwość przerzucenia fragmentu własnych łatek do upstreamu i zmniejszenia różnicy między twoim forkiem a projektem bazowym.

To nie musi oznaczać od razu sponsorowania fundacji. Czasem wystarczy regularne raportowanie bugów, drobne pull requesty i obecność na liście mailingowej. Dla security startupu to po prostu element redukcji ryzyka w łańcuchu dostaw.

Projektowanie produktu security „open source first”

Decyzje architektoniczne z myślą o otwieraniu kodu

„Zrobimy closed source, a potem najwyżej coś otworzymy” kończy się zwykle tym, że nic sensownego otworzyć się nie da. Przy podejściu open‑source‑first parę decyzji podejmuje się inaczej już na etapie architektury:

- wydzielenie czystych, małych komponentów, które mogą być „publicznym core’em” (agent, SDK, pluginy),

- separacja logiki domenowej klienta od ogólnej logiki bezpieczeństwa,

- traktowanie część kodu jako „podejrzanej” z punktu widzenia IP (np. reguły korelacji, modele ML) i trzymanie ich w innych repo/projektach.

W praktyce sprowadza się to do prostego pytania zadawanego przy nowych modułach: „czy to jest kandydat na open source?”. Jeśli tak, projektuje się go od razu tak, by nie ciągnął za sobą całej reszty monolitu.

Granica między „core” a „secret sauce”

Najtrudniejszym elementem w produktach security jest odcięcie „publicznego” rdzenia od części, która rzeczywiście buduje przewagę. Kilka pomocniczych zasad:

- Core open source dostarcza:

- standardowe integracje (syslog, CloudTrail, Kubernetes, EDR-y),

- mechanizmy zbierania i normalizacji danych,

- API/pluginy pozwalające pisać własne rozszerzenia.

- Warstwa komercyjna zawiera:

- zaawansowane korelacje między źródłami i klientami,

- treści: reguły, playbooki, predefiniowane polityki,

- funkcje wymagające sporych nakładów operacyjnych (np. ML z ciągłym trenowaniem).

Jeżeli wszystko, co ma sens dla społeczności, zostaje „odcięte” do wersji enterprise, trudno zbudować zaufanie. Z kolei gdy zbyt wiele oddasz w open source, stajesz się darmowym backendem dla cudzych MSSP. Tu nie ma idealnej matematyki, ale dobrze mieć spisaną, zrozumiałą dla zespołu politykę open vs. closed.

Docs, API i extensibility jako „produkt dla deweloperów”

Przy podejściu open‑source‑first pojawia się drugi typ klienta: nie tylko SOC czy CISO, ale też inżynier, który chce się wpiąć w twoje narzędzie. Dla niego liczy się:

- stabilne, sensownie zaprojektowane API (REST/gRPC/GraphQL – wszystko jedno, byle spójne),

- dobre przykłady integracji – nawet jeśli to prosty skrypt, który wysyła alert do Slacka,

- możliwość własnego deployu open‑source’owego rdzenia, by go „pomacać” bez rozmowy z handlowcem.

Dokumentacja open source w security ma jeszcze jedną rolę: jest dowodem transparentności. Gdy klient widzi, jak wygląda proces zbierania, przetwarzania i przechowywania jego logów, łatwiej mu zaufać, że produkt nie robi po kryjomu dziwnych rzeczy. W security to nie detal UX, tylko czasem warunek zakupu.

Kontrybucje z zewnątrz – blessing czy utrapienie?

Kiedy produkt zyskuje popularność, zewnętrzne PR-y zaczynają spływać same. W security nie każda kontrybucja jest błogosławieństwem – zwłaszcza gdy dotyka logiki detekcji czy kryptografii. Potrzebne są jasne zasady gry:

- oddzielny obszar projektu na community rules/plugins z wyraźnym oznaczeniem „best effort, bez SLA”,

- proces przeglądu zmian związanych z bezpieczeństwem (cryptography, auth, privilege escalation) przez doświadczone osoby,

- jasny model odpowiedzialności – co jest wspierane komercyjnie, a co nie.

Część firm idzie krok dalej i wprowadza coś w rodzaju „trusted contributors”, których PR-y przechodzą szybciej w obszarach, na które się znają (np. integracje z konkretną chmurą). To nadal wymaga czujności, ale pozwala w praktyce korzystać z zalet community bez oddawania kontroli nad kluczowymi obszarami.

Telemetry, prywatność i „phoning home” w otwartym kodzie

Startupy SaaS żyją z telemetry – wiedzy o tym, jak użytkownicy korzystają z produktu. W security i przy kodzie open source sprawa jest delikatna. Klient, który buduje system ochrony, niekoniecznie chce, by ten system „dzwonił do domu” co pięć minut z agenta zainstalowanego w sieci krytycznej infrastruktury.

Da się to pogodzić, ale wymaga kilku zasad:

- pełna jawność mechanizmów telemetry w kodzie – co, gdzie, kiedy i w jakiej formie jest wysyłane,

- łatwa możliwość wyłączenia telemetry na poziomie konfiguracji lub zmiennej środowiskowej,

- osobne tryby dla środowisk air‑gapped (np. telemetry zbierana lokalnie i eksportowana offline),

- zachowanie ostrożności z danymi, które mogą ujawniać topologię sieci, konfigurację bezpieczeństwa czy identyfikatory klientów.

Transparentnie zrealizowana telemetry bywa wręcz argumentem sprzedażowym: pokazuje, że firma nie musi niczego ukrywać w binary blobach. Paradoksalnie, kod open source w tym obszarze chroni obie strony.

Roadmapa rozwoju: community‑driven czy enterprise‑driven?

Produkty security z komponentem open source żyją pomiędzy dwoma grawitacjami: tym, co potrzebuje społeczność, a tym, co płacący klienci wpisują do umów. Ignorowanie którejkolwiek z nich kończy się źle. Kilka praktyk równoważy tę dynamikę:

- publiczny backlog dla części open‑source’owej, gdzie widać, które funkcje są „community first”,

- wskazywanie, które elementy rodzą się jako open source, a które wyłącznie w wersji enterprise,

- okresowe „synci” roadmapy – np. co kwartał sprawdzenie, czy wymagania klientów enterprise nie zabijają rozwojowo rdzenia projektu.

W dłuższej perspektywie community i tak głosuje nogami. Projekt, który jest tylko frontem marketingowym dla wersji enterprise, nie przyciąga kontrybucji. Z kolei produkt, który słucha wyłącznie GitHuba, ale nie umie wystawić oferty dla korporacji, kończy jako fajne narzędzie dla pasjonatów bez budżetu na rozwój.

Budowanie zaufania: audyty, bug bounty i „otwarte” incydenty

Kod open source nie oznacza automatycznie, że jest bezpieczny. W security to dopiero początek rozmowy. Coraz częściej klienci pytają o:

- regularne audyty zewnętrzne (code review, pentesty, przeglądy architektury),

- programy bug bounty ukierunkowane na produkt i jego integracje,

- transparentne procedury reagowania na incydenty – także wtedy, gdy błąd zostanie znaleziony w otwartej części kodu.

Dobrze zaprojektowany proces security incident response obejmuje zarówno część otwartą, jak i zamkniętą produktu. Chodzi m.in. o:

- spójny system CVE / security advisories dla wszystkich komponentów,

- jasne wytyczne dla klientów, czy błąd dotyka jedynie open source, czy też części komercyjnej,

- procedurę szybkiego wypuszczenia poprawek także do forków / instalacji on‑prem, które klient trzyma w swoich repozytoriach.

To obszar, gdzie transparentność open source w połączeniu z dojrzałą reakcją na incydenty często wygrywa z „czarną skrzynką” zamkniętych konkurentów. O ile oczywiście poza otwartym repozytorium istnieje też solidny proces i ktoś faktycznie trzyma za to odpowiedzialność.

Najczęściej zadawane pytania (FAQ)

Czym różni się open source od „darmowego” oprogramowania w startupie security?

Open source to przede wszystkim licencja, która pozwala zajrzeć do kodu, modyfikować go, tworzyć własne wersje i dystrybuować dalej – często również komercyjnie. Masz więc realną kontrolę techniczną nad komponentem: możesz poprawić błąd, zmienić logowanie, dodać integrację.

„Darmowe oprogramowanie” (freeware) to zwykle zamknięty kod, bez prawa modyfikacji i z ograniczeniami komercyjnego użycia. Dla startupu security, który musi reagować szybko i grzebać głęboko w mechanizmach bezpieczeństwa, freeware jest najczęściej ślepą uliczką.

Jakie licencje open source są najbezpieczniejsze dla komercyjnego startupu security?

Najbardziej przewidywalne dla komercyjnego produktu są licencje permissive: MIT, Apache 2.0, BSD. Pozwalają na użycie w produkcie zamkniętym, modyfikacje i sprzedaż, pod warunkiem zachowania informacji o autorach i licencji w dokumentacji czy plikach NOTICE.

Bardziej „zaraźliwe” licencje copyleft (np. GPL) mogą wymagać otwarcia Twojego kodu, jeśli łączysz go z danym komponentem w określony sposób. W security, gdzie sporo logiki to know-how firmy, lepiej używać GPL świadomie i po konsultacji z prawnikiem technicznym, a nie „bo ktoś tak zrobił na GitHubie”.

Jakie są główne ryzyka korzystania z open source w produkcie security?

Najczęstsze problemy to:

- podatności w bibliotekach, których nikt nie aktualizuje,

- niezgodność licencyjna (np. wciągnięcie komponentu GPL do zamkniętego produktu),

- brak wiedzy, co właściwie siedzi w zależnościach – klasyczne „MVP z 27 bibliotek”.

Dla startupu security bolesne jest to podwójnie: klienci oczekują, że sam pilnujesz łańcucha dostaw oprogramowania. Gdy pierwsze duże logo poprosi o SBOM i opis procesu zarządzania podatnościami, improwizacja kończy się szybko.

Jak kontrolować zależności open source w MVP, żeby nie wpaść na minę przy pierwszym dużym kliencie?

Najprościej od początku wprowadzić kilka lekkich nawyków:

- generowanie listy zależności (SBOM) automatycznie w CI/CD,

- oznaczanie krytycznych komponentów (np. crypto, parsowanie protokołów, agent systemowy) i dokładne przeglądanie ich licencji,

- regularne skanowanie podatności w zależnościach (SCA) i utrzymywanie prostego changeloga aktualizacji.

W praktyce chodzi o to, żeby po pytaniu klienta „z czego to jest zbudowane?” nie musieć kopać po omacku po folderze node_modules przez trzy dni. Dobrze ustawione CI robi 80% roboty za zespół.

Czy budowanie produktu security na open source zwiększa zaufanie klientów?

Często tak, o ile jesteś w stanie pokazać, że nad tym panujesz. Klient B2B chętniej zaakceptuje rozwiązanie oparte na znanych projektach open source niż „magiczny silnik, którego nikomu nie pokażemy”, szczególnie gdy narzędzie widzi logi, ruch sieciowy czy dane użytkowników.

Otwarte komponenty dają możliwość audytu, większą przejrzystość algorytmów i mniejsze ryzyko vendor lock-in w krytycznej warstwie. W rozmowach sprzedażowych to często realny argument, a nie tylko „ładny slajd o community”.

Jak open source przyspiesza rozwój produktu w startupie security?

Gotowe biblioteki i projekty pozwalają ominąć budowanie od zera całych klocków infrastruktury: systemu logowania, parsowania protokołów, kryptografii, orkiestracji kontenerów czy monitoringu. Dzięki temu MVP da się postawić w tygodnie, a nie miesiące, a zespół skupia się na własnej logice bezpieczeństwa i UX dla analityka.

Dodatkowo społeczność reaguje szybko na nowe zagrożenia – łatki pod podatności czy nowe reguły pojawiają się błyskawicznie. Zamiast samodzielnie gonić cały świat, korzystasz z efektu skali pracy innych zespołów.

Jak wygląda typowy stack open source w młodym produkcie security?

Nawet mały produkt security to kilka warstw. Standardowy zestaw to:

- system: Linux jako baza (Ubuntu, Debian itd.),

- kontenery i orkiestracja: Docker + Kubernetes, często z Helmem, Prometheusem, Grafaną,

- warstwa danych: PostgreSQL plus silnik wyszukiwania (Elasticsearch, OpenSearch),

- backend i frontend: np. Go/Python + framework webowy oraz React/Vue,

- krypto: sprawdzone biblioteki (OpenSSL, libsodium, biblioteki wbudowane w język).

Dla klienta to „po prostu platforma do analizy logów”, a dla zespołu – kilkanaście projektów open source z własnymi cyklami wydań, podatnościami i licencjami. Im wcześniej to uporządkujesz, tym mniej gaszenia pożarów przy skali.

Co warto zapamiętać

- Open source to nie „darmowe oprogramowanie”, lecz konkretne prawa wynikające z licencji (wgląd w kod, modyfikacje, dystrybucja, często użycie komercyjne), których freeware zazwyczaj w ogóle nie daje.

- Dla startupu security kluczowa jest kontrola nad komponentem: możliwość poprawienia błędów, dostosowania funkcji i integracji z własnym silnikiem – bez otwartego kodu i jasnej licencji jest to po prostu nierealne.

- Open source drastycznie przyspiesza budowę produktu i obniża próg wejścia finansowego, ale „oszczędność na licencjach” wraca później jako koszt utrzymania, patchowania podatności i pilnowania zgodności licencyjnej.

- Stack oparty na popularnych projektach open source ułatwia rekrutację (inżynierowie pracują z narzędziami, które znają) i budowanie marki technologicznej, bo można bez wstydu pokazać kawałki kodu światu.

- Transparentny kod zwiększa zaufanie klientów B2B: da się go niezależnie zrewidować, zrozumieć algorytmy detekcji i uniknąć pełnego vendor lock-in w krytycznych elementach, co w security jest bardziej przekonujące niż „magiczny, zamknięty silnik”.

- Open source działa jak dopalacz innowacji – pozwala szybko eksperymentować, forknąć projekt, który nie nadąża, oraz korzystać z tempa reakcji społeczności na nowe zagrożenia; wiele dzisiejszych platform security zaczynało jako małe narzędzia open source.

- MVP złożone z „27 bibliotek z GitHuba” wygląda efektownie na demo, ale bez kontroli nad zależnościami (SBOM, licencje, proces zarządzania podatnościami) zamienia się w pole minowe, szczególnie gdy pierwszy duży klient wyciąga checklistę compliance.

Bibliografia

- The Open Source Definition. Open Source Initiative – Definicja open source i kryteria licencyjne

- Free Software Definition. Free Software Foundation – Różnice między wolnym oprogramowaniem a innymi modelami licencji

- Open Source Software: A Primer for Risk Managers. ENISA (2020) – Ryzyka i dobre praktyki zarządzania open source w bezpieczeństwie

- NIST Special Publication 800-218: Secure Software Development Framework. NIST (2022) – Wytyczne bezpiecznego wytwarzania oprogramowania, także z OSS

- The State of Open Source Security. Snyk (2022) – Raport o podatnościach, utrzymaniu i ryzykach w ekosystemie OSS

- Open Source Software in Commercial Products. Linux Foundation (2021) – Wpływ OSS na modele biznesowe i innowacje w firmach technologicznych

- Open Source Software Security: Risk, Benefits, and Best Practices. Carnegie Mellon University Software Engineering Institute (2014) – Analiza korzyści i ryzyk bezpieczeństwa przy użyciu OSS

- The Open Source Enterprise Playbook. Red Hat (2019) – Wykorzystanie open source w firmach, w tym aspekty licencyjne i operacyjne